카카오, 텍스트·이미지 동시에 이해하는 '카나나V' 성능 공개

페이지 정보

본문

* 공식 테크 블로그 내용

이미지도 찰떡같이 이해하는 카카오의 멀티모달 언어모델 Kanana-v 알아보기

https://tech.kakao.com/posts/667

* 뉴스1 기사 내용 일부

https://v.daum.net/v/20241205164142772

카카오(035720)가 한국어, 한국 문화, 장소 등에 특화된 자체 멀티모달 언어모델(MLLM) '카나나-v'(Kanana-v)의 성능과 특징을 공식 테크블로그를 통해 5일 공개했다. …

카나나 모델은 언어모델(LLM) 3종과 MLLM 3종, 비주얼 생성모델 2종, 음성모델 2종으로 크기나 종류, 특성에 따른 하위 모델들과 함께 구성된다.

테크블로그에서 공개한 '카나나-v'는 MLLM이다. 카카오는 언어모델을 기반으로 텍스트, 이미지, 오디오 등 다양한 모달리티를 통합적으로 처리할 수 있는 멀티모달 언어모델을 개발해왔다.

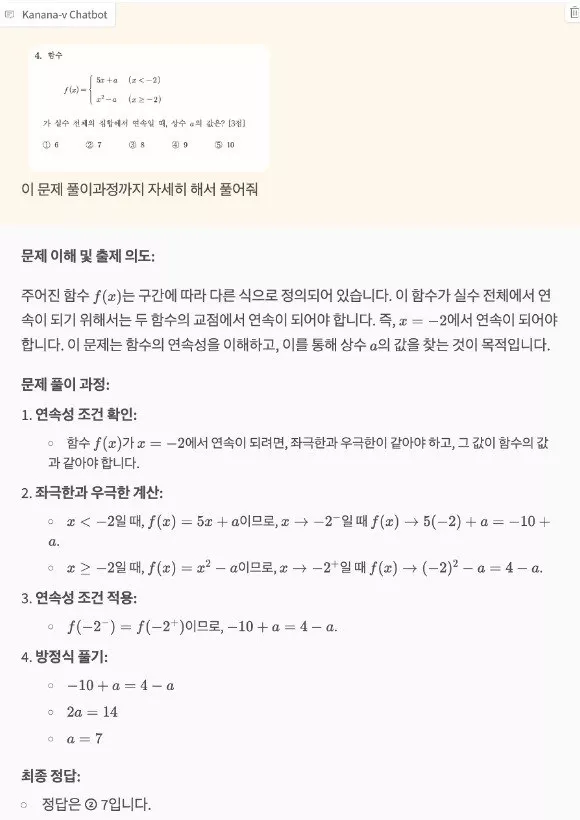

'카나나-v'는 사용자가 제공하는 이미지에서 정보를 이해하고 적절한 답변을 제공한다. 한국어의 고유 특성과 문화적 맥락을 잘 이해해 다양한 한국어 능력을 수행할 수 있도록 설계했다.

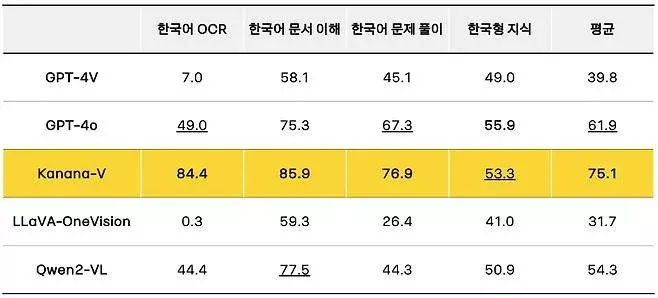

오픈AI의 GPT 4o 등 글로벌 모델과 △한국어 OCR △한국어 문서·도표 이해 △한국어 문제 풀이 △한국 문화 지식 이해를 기준으로 성능 비교를 진행한 결과 '카나나-v'가 전반적으로 뛰어난 성능을 기록했다.

특히 한국어 인식 능력을 판단하는 OCR 항목에서 압도적인 성능을 보이는 것으로 나타났다. OCR은 이미지를 스캔하거나 사진으로 찍은 문서에서 텍스트를 추출하는 기술이다. [이후 내용 생략]

초식동물님의 댓글

카카오는 서비스던 오픈 소스던 간에 쓸수 있는 방법도 알려줬으면 좋겠네요.

가꾸님의 댓글