미스트랄, 속도 개선한 코드 생성 모델 Codestral Mamba 발표

페이지 정보

본문

[공식 소개 링크] https://mistral.ai/news/codestral-mamba/

* 아래부터는 VentureBeat 기사 내용

Mistral releases Codestral Mamba for faster, longer code generation

https://venturebeat.com/ai/mistral-releases-codestral-mamba-for-faster-longer-code-generation/

[내용 일부 Claude 3.5 Sonnet 번역 후 다듬음]

막대한 자금을 지원받은 프랑스 AI 스타트업 미스트랄(Mistral)이 2가지 대규모 언어 모델(LLM)을 새로 공개했습니다. 미스트랄은 강력한 오픈 소스 AI 모델을 개발하는 것으로 유명합니다.

하나는 수학에 특화한 모델이고, 다른 하나는 지난해 말 다른 연구진이 개발한 맘바(Mamba)는 새로운 구조를 바탕으로 한 프로그래머와 개발자용 코드 생성 모델입니다. 맘바는 대부분 주요 LLM이 사용하는 트랜스포머(Transformer) 구조의 Attention(주의) 메커니즘을 단순화해 효율성을 높이고자 합니다. 맘바 기반 모델은 일반적인 트랜스포머 기반 모델과 다르게 추론 속도가 더 빠르고 더 긴 문맥을 다룰 수 있습니다. AI21을 비롯한 여러 기업과 개발자들이 이것을 기반으로 한 새로운 AI 모델을 출시했습니다.

[예] AI21 사례 (올해 3월) - https://www.ai21.com/blog/announcing-jamba

미스트랄에서는 새 구조를 바탕으로 Codestral Mamba 7B라는 모델을 개발했습니다. 이 모델은 긴 입력 텍스트에도 빠른 응답 속도를 보여줍니다. 코드 생산성 향상 용도로 잘 작동하며, 특히 소규모 코딩 프로젝트에 더욱 효과적입니다.

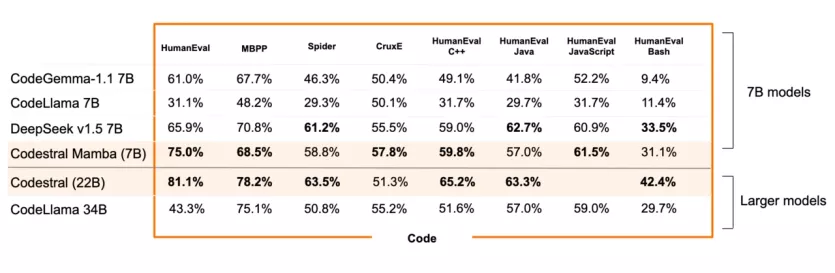

미스트랄 La Plateforme API에서 무료로 사용할 수 있는 이 모델은 최대 256,000 토큰을 처리할 수 있어, OpenAI가 만든 GPT-4o보다 2배 많은 양을 다룰 수 있습니다. 벤치마크 테스트에서 Codestral Mamba가 HumanEval 테스트에서 CodeLlama 7B, CodeGemma-1.17B, DeepSeek 등 경쟁 오픈 소스 모델들보다 우수한 성능을 보였다고 발표했습니다.

개발자들은 GitHub 저장소나 Hugging Face를 통해 Codestral Mamba를 자유롭게 수정하고 배포할 수 있습니다. 이 모델은 Apache 2.0 오픈 소스 라이선스로 제공될 예정입니다. [이후 내용 생략]

아름다운별님의 댓글

https://mistral.ai/news/mathstral/