알리바바 Qwen, 오픈소스 시각 추론 AI 모델 QVQ 공개

페이지 정보

본문

[관련 링크 모음]

* 데모 페이지 - https://huggingface.co/spaces/Qwen/QVQ-72B-preview

* 모델 다운로드 - https://huggingface.co/Qwen/QVQ-72B-Preview

* 소개 페이지 - https://qwenlm.github.io/blog/qvq-72b-preview/

* The Decoder 기사

Qwen's open-source QVQ rivals OpenAI and Google's best models in visual reasoning

# 내용 일부 GPT-4o 번역 후 수정

알리바바의 AI 연구팀 Qwen에서 이미지를 해석하고 결론을 도출할 수 있는 오픈소스 모델 QVQ-72B-Preview를 발표했습니다. 실험 단계에 머물러 있지만, 초기 테스트에서는 시각적 추론 작업에서 우수한 성능을 보였습니다.

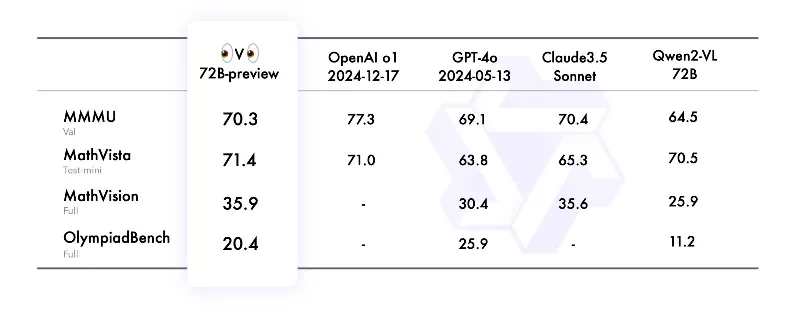

QVQ-72B-Preview는 Qwen이 개발한 기존 비전-언어 모델 Qwen2-VL-72B를 바탕으로 만들어졌으며, 여기에 사고와 추론 기능이 더해졌습니다. Qwen은 이 모델이 해당 분야에서 최초의 오픈소스 모델이라고 주장합니다. 최근 공개된 QwQ 추론 모델과 비슷해 보이지만, 두 모델 간의 관계에 대해 구체적으로 설명하지는 않았습니다. [중략]

테스트 결과, QVQ는 이전 모델 Qwen2-VL-72B-Instruct를 전반적으로 능가했으며, OpenAI o1이나 Claude 3.5 Sonnet과 같은 비공개 모델과 비슷한 정확도를 기록했다고 합니다. [나머지 내용 생략]

* 알리바바 Qwen 공식 X(트위터) 계정이 올린 글